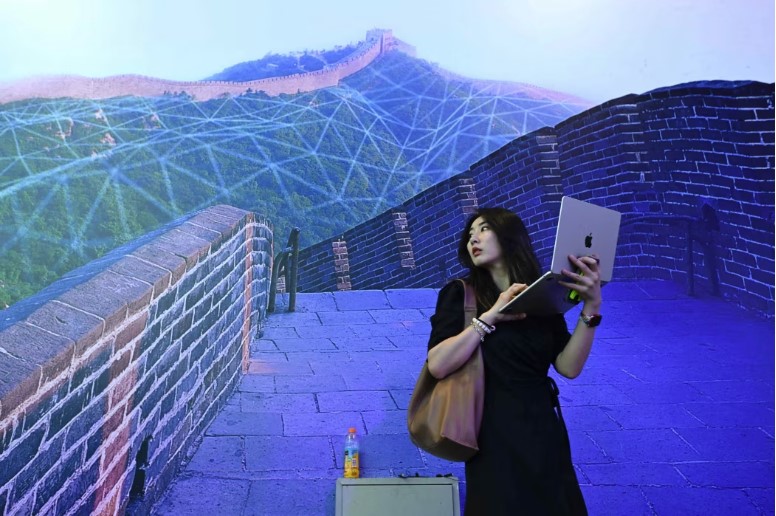

華爾街日報廿四日報導,中國擔憂人工智慧(AI)恐危及中國共產黨一黨專制,正採取獨特手段進行控制與為其所用,做法包括規定具有獨立思考能力的AI聊天機器人接受「政治正確」訓練、三個月內移除近百萬筆不當的AI生成內容,以及聊天機器人訓練材料安全性至少達九六%,否則禁用。 報導指出,儘管北京當局明知AI對中國經濟與軍事未來至為重要,但相關法規與近日對線上

華爾街日報廿四日報導,中國擔憂人工智慧(AI)恐危及中國共產黨一黨專制,正採取獨特手段進行控制與為其所用,做法包括規定具有獨立思考能力的AI聊天機器人接受「政治正確」訓練、三個月內移除近百萬筆不當的AI生成內容,以及聊天機器人訓練材料安全性至少達九六%,否則禁用。

報導指出,儘管北京當局明知AI對中國經濟與軍事未來至為重要,但相關法規與近日對線上內容進行大清洗表明,北京也同樣擔心AI破壞社會穩定,尤其是聊天機器人憑藉自主思考能力生成的回答,恐令人質疑中共統治。

此外,中國當局日前表示,已在一場歷時三個月的專案行動,清理掉九十六萬多條違法違規的AI生成內容;AI甚至被列為重大潛在威脅,與地震以及流行病一同納入「國家突發事件總體應急預案」。熟悉北京想法的人士認為,中國當局也不想管過頭,以免扼殺創新,導致中國在全球AI競賽中屈居對AI監管較鬆的美國;但北京同時也無法承受任由AI恣意妄為的後果。

例如,中國AI模型的國際排名不俗,但卻會審查有關六四天安門屠殺、人權問題以及其他敏感議題的回答。此外,中國也無法使用大多數美國主流AI模型。隨著AI系統日益複雜,DeepSeek等中國AI模型恐因審查而更難追趕上美國AI模型的腳步。

有跡象表明,中國刻正試圖在兩者間求取微妙平衡。北京當局在今年十一月敲定與AI公司研議多時的規定,AI公司的人工測試員應隨機抽樣至少四千筆訓練材料,以及得確保該材料安全率至少達九六%,否則整個數據庫全部禁用;至於何謂不安全的材料,則明確列出卅一種風險,其中第一項就是涉及煽動顛覆國家政權與推翻社會主義制度的內容。其他風險則有包含宣揚暴力的內容、假訊息或歧視,以及侵犯他人肖像權。所有AI生成的文字、影片與圖像,都必須明確標記以及可追溯,使之能更容易追蹤與懲罰任何散播不當內容者。